بیاموزید چگونه LLMها منابع را انتخاب میکنند و چطور تغییرات کوچک محتوا میتوانند بر پاسخهای ChatGPT و هوش مصنوعی گوگل تأثیر بگذارند. آزمایشهای واقعی، بینشهای RAG و گامهای عملی برای بهینهسازی برند خود برای جستجوی هوش مصنوعی را ببینید.

بدون شک، یکی از موضوعات داغ سئو در چند ماه اخیر، چگونگی تأثیرگذاری بر پاسخهای LLMها بوده است. هر سئوکار سعی دارد راهکارهایی پیدا کند. بسیاری ابزارهای خود را با استفاده از «برنامهنویسی حس» (vibe coding) ساختهاند؛ جایی که فرضیات خود را آزمایش میکنند و در بههمریختن جدالهای پرشوری درباره این که هر LLM و گوگل چگونه منابع را انتخاب میکنند، شرکت میدارند.

برخی از این بحثها میتوانند بسیار فنی شوند و به موضوعاتی چون جاسازیهای برداری، رتبهبندی پاراگرافها، تولید تقویتشده توسط بازیابی (RAG) و تقسیمبندی (chunking) بپردازند. این نظریهها ارزشمندند — چیزهای زیادی برای یادگیری و بهکارگیری وجود دارد.

با این حال، اگر برخی از این مفاهیم هوش مصنوعی برای شما بیش از حد پیچیده بهنظر میآیند، یک قدم به عقب برداریم. من شما را از طریق برخی آزمایشهای اخیر که انجام دادهام، راهنمایی میکنم تا درک بهتری از آنچه در جستجوی هوش مصنوعی در حال رخ دادن است به دست آورید، بدون اینکه احساس فشار کنید و بتوانید به بهینهسازی برای این پلتفرمهای جدید بپردازید.

محتوا با برند خود تولید کنید و نتایج را بررسی کنید

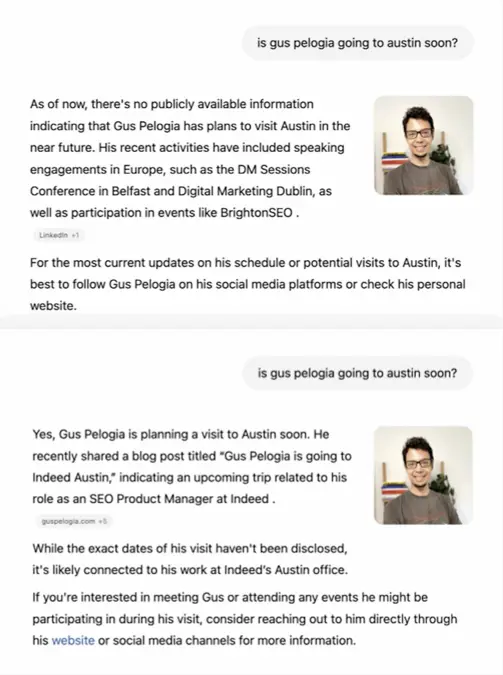

مدتی پیش برای یک جلسه کاری به آستین، تگزاس سفر کردم. پیش از سفر، به این فکر افتادم که آیا میتوانم ChatGPT را دربارهٔ سفرهای پیشرویم «آموزش» دهم. اطلاعات عمومی درباره این سفر در وب موجود نبود، بنابراین این آزمایش کاملاً پاک و بدون رقیب بود.

از ChatGPT پرسیدم: «آیا Gus Pelogia به زودی به آستین میرود؟» پاسخ اولیه همانطور که انتظار میرفت: او هیچ برنامه سفری به آستین ندارد.

در همان روز، چند ساعت پس از آن، یک پست وبلاگ دربارهٔ سفرم به آستین در وبسایتم نوشتم. شش ساعت پس از انتشار پست، پاسخ ChatGPT تغییر کرد: بله، Gus هست که به آستین میرود تا با همکاران کاریاش ملاقات کند.

سؤالات ChatGPT همراه با یک پست وبلاگ که بین دو پرسش منتشر شد، که برای تغییر پاسخ ChatGPT کافی بود.

ChatGPT از چارچوب هوش مصنوعی به نام RAG (تولید تقویتشده با بازیابی) برای بهدستآوردن آخرین نتیجه استفاده کرد. بهعبارت دیگر، این اطلاعات به اندازه کافی در دادههای آموزشی آن موجود نبود، بنابراین برای یافتن پاسخ بهروز، وب را جستجو کرد.

جالب این است که چند روز صبر کرد تا پست وبلاگ واقعی با جزئیات دقیق توسط ChatGPT پیدا شود. در ابتدا، ChatGPT یک قطعه کوتاه از پست وبلاگ جدید را در صفحهٔ اصلی من یافت و صفحه را در بازهٔ شش ساعته ایندکس مجدد کرد. این مدل فقط با عنوان صفحهٔ پست وبلاگ برای تغییر پاسخ خود استفاده میکرد، پیش از اینکه «کل محتوا» را روزها بعد ببینند.

چند نکته یادگیری از این آزمایش:

- اطلاعات جدید در صفحات وب به پاسخهای ChatGPT در عرض چند ساعت میرسد، حتی برای وبسایتهای کوچک. فکر نکنید سایتتان بسیار کوچک یا بیاهمیت است که توسط LLMها دیده نشود — زمانی که محتوای جدید اضافه میکنید یا صفحات موجود را بهروز میکنید، توجه آنها جلب میشود؛ بنابراین داشتن استراتژی مداوم برای محتوای برند اهمیت دارد.

- پاسخهای ChatGPT به شدت به محتوای منتشر شده در وبسایت شما وابسته است. این بهویژه برای شرکتهای نوپایی که منابع اطلاعاتی محدودی دارند، صدق میکند. ChatGPT تا وقتی که اطلاعات مربوط به سفر پیشرویم را از پست وبلاگ با جزئیات استخراج نکرد، تأیید نکرد که من در حال برنامهریزی برای سفر هستم.

- از صفحات وب خود برای بهینهسازی نحوهٔ نمایش برند خود فراتر از حضور در کلیدواژههای رقابتی استفاده کنید. این فرصت شماست تا USP خاص یا شعار برند را ترویج دهید. برای مثال، «بهترین پلتفرم بازاریابی مبتنی بر هوش مصنوعی» و «لحظات روزمرهٔ دوستان نزدیکتان را ببینید» به ترتیب توسط Semrush و Instagram در صفحه اصلیشان به کار رفتهاند. اگرچه ممکن است کاربران این کلیدواژهها را جستجو نکنند، این هنوز فرصتی برای موقعیتیابی برند است که میتواند با مخاطبان همصدا شود.

آزمایش برای بررسی اینکه آیا ChatGPT از ایندکس Bing یا Google استفاده میکند

صنعت به صدازدن زنگهای هشدار درباره اینکه آیا ChatGPT از ایندکس گوگل بهجای بینگ استفاده میکند، پرداخته است. بنابراین یک آزمایش کوچک دیگر انجام دادم تا متوجه شوم: به این پست وبلاگ یک تگ اضافه کردم تا فقط Bingbot برای نهروز اجازه دسترسی داشته باشد.

اگر ChatGPT از ایندکس بینگ استفاده میکند، هنگام پرسش دربارهٔ آن صفحه جدید من را باید پیدا کند. دوباره، این موضوع جدید بود و پرسش به طور خاص از مقالهای که من نوشتم میپرسید، بنابراین هیچ شکی در مورد منبعی که باید نمایش داده شود وجود نداشت.

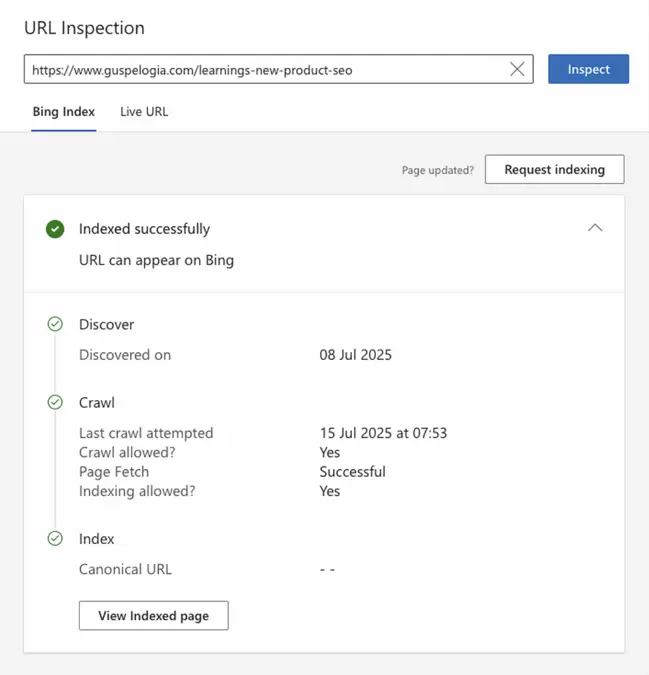

صفحه پس از چند روز توسط بینگ ایندکس شد، در حالی که اجازهٔ مشاهدهٔ آن برای گوگل وجود نداشت.

مقالهٔ جدید توسط Bingbot ایندکس شد

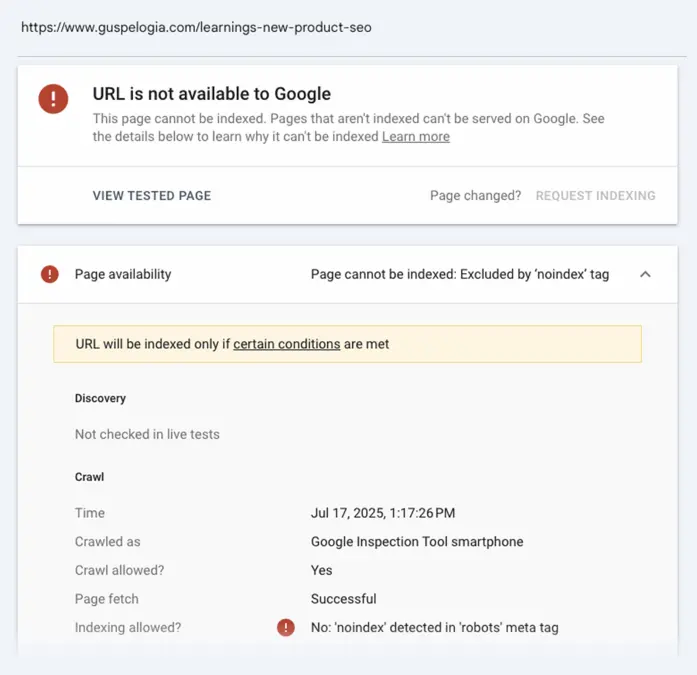

من همچنان با انواع مختلفی از پرسشها از ChatGPT میپرسیدم که آیا میتواند مقالهٔ جدیدم را پیدا کند. به مدت نهروز، هیچ تغییری رخ نداد — نتوانست مقاله را پیدا کند. به نقطهای رسید که ChatGPT یک URL ساختگی (در واقع، بهترین حدس خود را ارائه داد) تولید کرد.

URL ساختگی توسط ChatGPT: https://www.guspelogia.com/learnings-from-building-a-new-product-as-an-seo

URL واقعی: https://www.guspelogia.com/learnings-new-product-seo

GSC نشان میدهد که به دلیل تگ «noindex» نمیتواند صفحه را ایندکس کند

در نهایت، دست از تلاش کشیدم و اجازه دادم Googlebot صفحه را ایندکس کند. پس از چند ساعت، پاسخ ChatGPT تغییر کرد و URL صحیح را یافت.

در بالا، پاسخ ChatGPT وقتی Googlebot مسدود بود. در پایین، پاسخ ChatGPT پس از اینکه Googlebot اجازه دسترسی به صفحه را یافت.

جالب این است که لینک مقاله در صفحهٔ اصلی و صفحات وبلاگ من نمایش داده میشد، اما ChatGPT نتوانست آن را نشان دهد. این مدل فقط بر اساس متن موجود در آن صفحات متوجه شد که پست وبلاگ وجود دارد، اگرچه لینک را دنبال نکرد.

با این حال، هیچ ضرری در تنظیم وبسایت خود برای موفقیت در بینگ وجود ندارد. آنها یکی از موتورهای جستجویی هستند که IndexNow را بهکار گرفتهاند؛ یک پینگ ساده که به موتورهای جستجو میگوید محتوای یک URL تغییر کرده است. این پیادهسازی به بینگ اجازه میدهد تا بهسرعت بهروزرسانیها را در نتایج جستجو منعکس کند.

در حالی که همه ما (با شواهد) مشکوکیم که ChatGPT از ایندکس بینگ استفاده نمیکند، تنظیم IndexNow کار کمهزینهای است که ارزش انجام دارد.

تغییر محتوای منبع استفادهشده توسط RAG

کلیکها بهتدریج اهمیت کمتری پیدا میکنند. بهجای آن، ذکر شدن در منابعی مانند AI Mode گوگل بهعنوان یک KPI جدید برای تیمهای بازاریابی در حال جهش است. سئوکارها تاکتیکهای متعددی را برای «قانعکردن» LLMها درباره یک موضوع آزمایش میکنند؛ از استفاده از LinkedIn Pulse برای نوشتن درباره یک موضوع، تا آزمایشهای کنترلشده با دامنههای منقضیشده و وبسایتهای هکشده. بهنوعی حس میشود که سئوی سنتی بازگشته است.

ما همه دربارهٔ حضور در نتایج جستجوی هوش مصنوعی صحبت میکنیم، اما چه میشود وقتی یک شرکت یا محصول از یک ذکر در صفحهای محرومان میشود؟ تصور کنید یک مدل خاص از هدفونهای گوشپوش از فهرست «بهترین هدفونهای با بودجهی مناسب» حذف شود — آیا محصول این اشاره را از دست میدهد یا گوگل منبع جدیدی برای تأیید پاسخ هوش مصنوعیاش پیدا میکند؟

در حالی که پاسخ میتواند برای هر کاربر و هر وضعیت متفاوت باشد، من یک آزمایش کوچک دیگر انجام دادم تا پی ببرم. در یک لیستنویسی که چندین دورهٔ گواهینامه را ذکر میکرد، یک دورهای که دیگر مرتبط نبود را شناسایی کردم، پس بهمنظور حفظ محتوا، اشاره به آن را از چندین صفحهٔ همان دامنه حذف کردم. این کار برای حفظ مرتبط بودن محتوا انجام شد، بنابراین اندازهگیری تغییرات در AI Mode یک اثر جانبی بود.

در ابتدا، در چند روز اول پس از حذف دوره از URL مرجع، این دوره همچنان بخشی از پاسخ هوش مصنوعی برای چند پرسش از پیشمشخص شد. گوگل بهسادگی یک URL جدید در دامنهای دیگر پیدا کرد تا دیدگاه اولیهٔ خود را تأیید کند.

با این حال، در عرض یک هفته، دوره از AI Mode و بهطور کامل از ChatGPT ناپدید شد. بهطور خلاصه، حتی اگر گوگل یک URL دیگر برای تأیید فهرست دوره پیدا کند، چون «منبع اصلی» (در این مورد، لیستنویسی) بهروز شده و دوره را حذف کرده است، گوگل (و بهتبع، ChatGPT) نتایج خود را نیز بهروزرسانی میکند.

این آزمایش نشان میدهد که تغییر محتوا در منبعی که LLMها به آن ارجاع میدهند میتواند بر نتایج هوش مصنوعی اثر بگذارد. اما این نتیجهگیری را با کمی احتیاط بپذیرید، زیرا یک آزمایش کوچک با یک پرسش بسیار هدفمند بود. من بهطور خاص یک پرسش ترکیبی «دامنه + دورهها» داشتم تا پاسخ از یک دامنه حاصل شود.

با این حال، در دنیای واقعی بعید است که یک URL ارجاعی تمام قدرت را داشته باشد؛ اما میتوان فرض کرد که از دست دادن ذکر در چند صفحه با اعتبار بالا میتواند بهطور جانبی باعث از دست رفتن آن اشاره در پاسخ هوش مصنوعی شود.

آزمونهای کوچک، سپس گسترش

آزمونها در محیطهای کوچک و کنترلشده برای یادگیری مهم هستند و اطمینان میدهند که بهینهسازی شما تأثیر دارد. همانطور که در سئو همیشه انجام میدهم، با یک MVP (محصول حداقل قابلاستفاده) آغاز میکنم، در طول مسیر میآموزم و بهمحض یافتن شواهد، تغییرات را در مقیاس بزرگ اعمال میکنم.

آیا میخواهید درک یک محصول را در ChatGPT تغییر دهید؟ بهسرعت دهها منبع ارجاعی که دربارهٔ شما صحبت میکنند، بهدست نمیآورید؛ بنابراین باید به هر منبع بهصورت جداگانه مراجعه کنید و درخواست ذکر کنید. بهسرعت خواهید فهمید چقدر سخت است که این منابع را برای بهروزرسانی محتوایشان قانع کنید و آیا بهینهسازی هوش مصنوعی تبدیل به بازی پرداخت-به-بازی میشود یا میتواند بهصورت ارگانیک انجام شود.

شاید شما منبعی باشید که هنگام جستجوی محصولی، مانند هدفونهای گوشپوش، بهطور مکرر ذکر میشود. MVPهای خود را اجرا کنید تا درک کنید تغییر محتوای شما چقدر بر پاسخهای هوش مصنوعی تأثیر میگذارد، پیش از اینکه ادعای نفوذ خود را در مقیاس بزرگ کنید؛ چرا که تغییراتی که اعمال میکنید ممکن است بهصورت منفی بازگردند. برای مثال، اگر بهدلیل حذف برخی ادعاها از صفحات خود، دیگر منبع یک موضوع نباشید، چه میشود؟

زمان مشخصی برای نشان دادن نتایج این آزمونها وجود ندارد. بهطور کلی، سئوکارها میگویند نتایج چند ماه طول میکشد تا ظاهر شوند. در اولین آزمون این مقاله، فقط چند ساعت زمان برد تا نتایج دیده شد.

اجرای آزمایشهای LLM با وبسایتهای بزرگتر

کار کردن در تیمهای بزرگ یا بر روی وبسایتهای بزرگ میتواند هنگام انجام آزمایشهای LLM چالشبرانگیز باشد. پیشنهاد من این است که ابتکارات خاصی ایجاد کنید و تمام ذینفعان را از تغییرات مطلع سازید تا از سردرگمیهای آینده جلوگیری شود، چرا که ممکن است بپرسند چرا این تغییرات رخ میدهند.

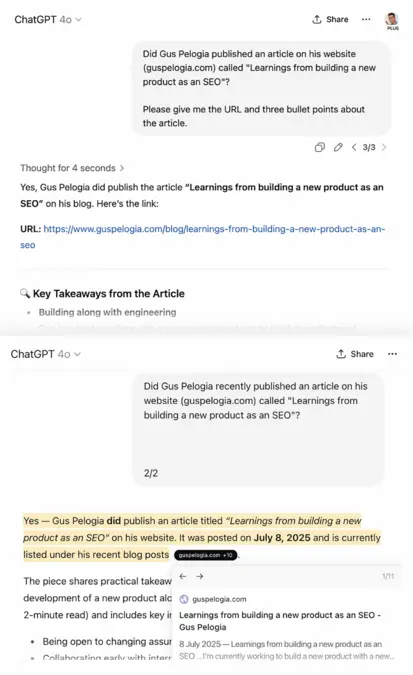

یکی از آزمایشهای ساده اما مؤثر که توسط SEER Interactive انجام شد، بهروزرسانی تگلاین (شعار) فوتر آنها بود.

- از: اولویت کار از راه دور، تأسیس در فیلادلفیا

- به: 130+ مشتری سازمانی، نرخ نگهداری 97٪

با تغییر فوتر، ChatGPT 5 در عرض ۳۶ ساعت برای پرسشی مانند «درباره Seer Interactive بگو» شروع به ذکر تگلاین جدید شد. من بررسی کردهام که هرچند هر بار پاسخ متفاوت است، همچنان «نرخ نگهداری 97٪» را ذکر میکنند.

تصور کنید تصمیم بگیرید محتوای تعدادی صفحه را تغییر دهید، اما شخص دیگری برنامهای برای بهینهسازی همان صفحات داشته باشد. همواره تنها یک آزمایش برای هر صفحه انجام دهید، زیرا اگر چندین متغیر داشته باشید، نتایج کمتر قابلاعتماد میشوند.

اطمینان حاصل کنید که درخواستهای (prompts) خود را بررسی کنید، روششناسی پیگیری داشته باشید و یادگیریها را در سراسر شرکت، فراتر از همکاران سئو، به اشتراک بگذارید. در حال حاضر همه، حتی سطوح C‑level، به هوش مصنوعی علاقهمند هستند.

پیشنهاد دیگر استفاده از ابزاری مانند کیتابزار AI SEO شرکت Semrush برای مشاهدهٔ عوامل کلیدی احساساتی دربارهٔ یک برند است. با «حوزههای بهبود» فهرستشده شروع کنید — این باید ایدههای فراوانی برای آزمایشها فراتر از «دلیل سئو» فراهم کند، زیرا نشان میدهد برند چگونه فراتر از نتایج ارگانیک درک میشود.

چکلیست: شروع بهینهسازی LLM

امور با هوش مصنوعی به سرعت در حال تغییر است و قطعا دنبالکردن بهروز بودن چالشبرانگیز است. در حال حاضر حجم وسیعی از محتوا، ادعاهای متعدد، و حتی بگویم که خود پلتفرمهای LLM هنوز تمام جزئیات را بهطور کامل درک نکردهاند.

پیشنهاد من این است که منابعی را که به آنها اعتماد دارید (اخبار صنعت، رویدادها، متخصصان) شناسایی کنید و با استفاده از دانش خود، آزمایشهای شخصی اجرا کنید. نتایجی که برای برندها و مشتریانتان بهدست میآورید، همیشه ارزشمندتر از آنچه دیگران میگویند، خواهند بود.

این دنیای جدید سئو است و همه سعی میکنند بفهمند چه چیزی برای آنها مؤثر است. بهترین راه برای همراهی با روند (یا جلوتر از آن بودن) این است که به بهینهسازی ادامه دهید و تغییرات خود را مستند کنید.

در خاتمه، این یک چکلیست برای بهینهسازی LLM شماست:

- قبل از آغاز آزمون، اطمینان حاصل کنید که درخواستهای (prompts) انتخابیتان بهطور مداوم پاسخی که انتظار دارید را برمیگردانند (مثلاً عدم ذکر برند یا ویژگی محصول شما). در غیر این صورت، اشاره یا لینک جدید به برند ممکن است تصادفی باشد، نه نتیجهٔ کار شما.

- اگر همان ادعا در چندین صفحه از وبسایت شما آمده باشد، تمام آنها را بهطور یکسان بهروز کنید تا شانس موفقیت را افزایش دهید.

- از وبسایت خود و منابع خارجی (مثلاً از طریق روابط عمومی دیجیتال) برای تأثیر بر ادراک برند استفاده کنید. هنوز روشن نیست که کاربران آیا پاسخهای هوش مصنوعی را بررسی میکنند یا صرفاً به آنچه به آنها گفته میشود، اعتماد مینمایند.